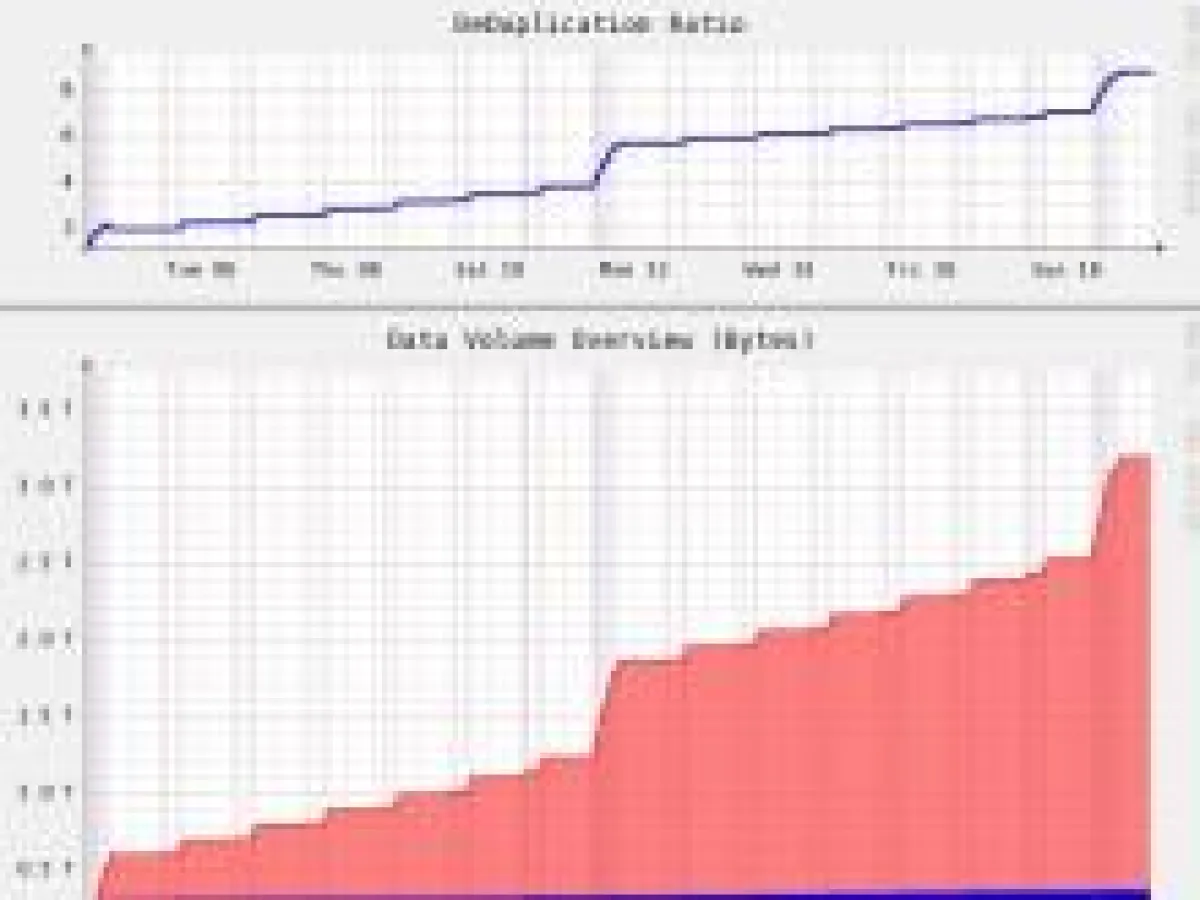

(openPR) München, 09.06.2008 – Bereits nach vier Wochen Langzeittest im »Virtual Storage Lab« zeigt sich der Nutzwert von Deduplikation. Das zu sichernde Backup-Volumen reduziert sich bisher um den Faktor 11. Noch bis zum 16. Juni 2008 können die Leser von speicherguide.de – Das Storage-Magazin auf den Ausgang des Tests tippen und einen von mehreren »iPods«gewinnen. Gesucht ist die Kapazität des Backup-Volumens nach der Deduplizierung zum Ende der Testphase.

Im Rahmen eines Langzeittests überprüft speicherguide.de – Das Storage-Magazin seit einigen Wochen den Nutzen von Datendeduplizierung in einem Praxisszenario. Das Testsystem, eine Quantum »Dxi3500«, wird täglich mit einem reellen Backup-Volumen bespielt. Über aktuelle Live-Grafiken können sich die Besucher über Zustand und Fortschritt des Tests informieren. Technisch wird das »Virtual-Storage-Lab« vom Bayreuther Trainings- und Consulting-Unternehmen InfoTouch betreut.

Die Leser von speicherguide.de und interessierte Besucher können nun bis einschließlich Montag, 16.06.2008, einen Tipp über die Endkapazität abgeben. Die drei besten Tipper gewinnen einen Apple »iPod«. Weitere Informationen zu »Deduplikation im Live-Test« finden sich im Internet unter http://lab.speicherguide.de.

Der direkte Link zur Deduplikations-Wette:

http://lab.speicherguide.de/special/lab/DeDupWette.asp

Erstes Resümee des Dedup-Langzeittests

Zum Start erzielte das System eine Reduktion um fast Faktor 2. Nach knapp vier Wochen Laufzeit liegt die Reduktionsrate bei etwas über 11:1. Bereits jetzt ist das Einsparpotenzial der Deduplizierungstechnik deutlich erkennbar. Das Testteam schätzt, dass wir nach einer Laufzeit von sechs Wochen knapp unter 15:1 liegen und nach acht Wochen fast 17:1 erreicht werden.

Aus der Beschreibung des Testszenarios

Auf den Servern der Testumgebung liegen zu Anfang des Tests 140.000 Office-Files (Word- und Powerpoint-Dokumente, in Summe 525 GByte), 100.000 E-Mails in Exchange und über 20 Millionen Records in einer MS-SQL-Datenbank, die zirka 22 GByte groß ist. Summa summarum also 615 GByte synthetisch erzeugte Office-Daten, die den Anspruch erheben, einer realen Büro-Umgebung sehr nahe zu kommen.

Damit die Realitätsnähe erhalten bleibt, ändern sich die Daten automatisiert. Während des gesamten Testlaufs kommen innerhalb der üblichen Büroarbeitszeiten von 8:30 bis 17:30 Uhr alle drei Minuten 2.000 Datensätze in der SQL-DB hinzu und weitere 1.000 werden geändert. Außerdem wird rund um die Uhr jede Minute ein neues Dokument mit in den Pool aufgenommen und eine E-Mail an den Exchange-Server geschickt. Dies summiert sich täglich zu 1.440 neuen Dokumenten, 1.440 E-Mails und 540.000 neuen bzw. geänderten Datensätzen in der Datenbank. So lassen sich reales Datenwachstum und Änderungsvolumen simulieren. Mehr Infos auf http://lab.speicherguide.de.

Deduplikation im Detail

Je optimaler ein Disk-Backup-System genutzt wird, desto besser. Wenn identische zu sichernde Dateien nicht mehrfach gespeichert werden müssen, spart dies Kapazität und gleichzeitig Investitionskosten. Die Deduplikationstechnik eliminiert unerwünschte Redundanzen.

Bei der Datendeduplizierung sucht ein Algorithmus nach bestimmten Merkmalen innerhalb einer Datei bzw. eines Datenstroms. Es geht darum, beispielsweise Anfang und Ende eingebetteter Element zu erkennen, zum Beispiel von Logos oder Fotos. Im Prinzip handelt es sich um die intelligente Erkennung sich wiederholender Objekte beliebiger Größe. Die Wiedererkennung erfolgt direkt im Datenstrom und ist unabhängig von Format oder Anschluss. Eine Manipulation der Daten wie Komprimierung oder Verschlüsselung würde diese Wiedererkennung verhindern und darf erst nach der Deduplizierung und somit nicht auf Client-Seite passieren.

Mehr Infos auf speicherguide.de im Schwerpunkt »Disk-Backup« http://www.speicherguide.de/magazin/diskbackup.asp

und im Virtual-Storage-Lab http://lab.speicherguide.de.