(openPR) Web Seminar („Webinar“) am 3. April 2008, 14:00 Uhr

Teilnahme kostenlos - Anmeldung erforderlich

Ort: Im Internet - trilliumsoftware.webex .com unter "Event Center"

(hh) Wer kann schon spontan sagen, wie gut die Qualität seines Datenbestands ist? Doch bei der Nutzung des Datenbestands ist immer Vorsicht geboten. Eine schlechte Datenqualität kann negative Auswirkungen haben. Wichtige Ereignisse, die mit Datenmigrationen verbunden sind, wie zum Beispiel Fusionen oder Übernahmen, werden oft durch diesen immer wiederkehrenden Fehler untergraben. Unvollständige, falsch zugeordnete, veraltete oder andere Daten in schlechter Qualität schaden dem Ergebnis oft unbemerkt. Doch gerade die Datenprobleme, die unentdeckt und deshalb nicht bewusst sind, sind die gefährlichsten.

Mit entsprechenden Profiling Tools lassen sich Daten jedoch hinsichtlich der Qualität analysieren. Damit werden fehlerhafte Daten entdeckt und offen gelegt. Die Datenqualität kann so gesichert und verbessert werden.

Die Harte-Hanks Trillium Software GmbH in Böblingen veranstaltet am 3. April 2008 ein Webinar (Web Seminar) zum Thema „Data Profiling“, das um 14:00 Uhr online stattfindet. Durch das Thema führt Peter Strippel, ein ausgewiesener Spezialist für alle Fragen rund um das Thema Data Profiling und Datenanalyse. Er erläutert in diesem Webinar, wie mit Data Discovery unbekannte Faktoren offengelegt werden können, die anderenfalls wahrscheinlich unentdeckt und schädlich blieben.

Anhand ausgewählter Beispiele wird erläutert, wie das Data Profiling im Unternehmen durchgeführt werden kann. Dabei wird auch darauf eingegangen, wie mit Data Governance die Datenstandards auf einem hohen Niveau gehalten und wie mit der Datenüberwachung bzw. dem Data Monitoring die Datenqualität fortlaufend beobachtet und auf einem hohen Niveau sichergestellt werden kann.

Interessenten können sich unter dem Menüpunkt „Event Center“ auf https://trilliumsoftware.webex.com anmelden.

Weitere Informationen zum Datenqualitäts-Webinar unter ![]() und telefonisch bei Andrea Walleter, Tel: 07031 – 2 09 01-10

und telefonisch bei Andrea Walleter, Tel: 07031 – 2 09 01-10

Presseinformation

Data Profiling analysiert die Qualität des Datenbestands - Webinar zum Thema Datenqualität am 3. April 2008

![Dublette oder zufällige Namensgleichheit? Wie steht es um die Qualität Ihrer Daten? [(c) Photocase]](https://cdn.open-pr.de/pressemitteilung/c/e/0/ce06fda3.1200x900.webp)

Diese Pressemeldung wurde auf openPR veröffentlicht.

Verantwortlich für diese Pressemeldung:Anschrift und Kontakt:

Harte Hanks Trillium Software GmbH,

Otto-Lilienthal-Straße 36, D-71034 Böblingen

Tel: +49 (0)7031 / 2 09 01-10 (Frau Andrea Walleter)

Fax: +49 (0)75 31 /81 45-81

E-Mail:

Website: http://www.TrilliumSoftware.de

Pressekontakt:

Holger Hagenlocher, Agentur für Marketing & PR

Otto-Lilienthal-Straße 36, D-71034 Böblingen

Tel: +49 (0)7031 / 71 49 35

Fax: +49 (0)7031 / 71 49 39

E-Mail:

Website: http://www.hagenlocher-pr.com

Harte Hanks Trillium Software GmbH,

Otto-Lilienthal-Straße 36, D-71034 Böblingen

Tel: +49 (0)7031 / 2 09 01-10 (Frau Andrea Walleter)

Fax: +49 (0)75 31 /81 45-81

E-Mail:

Website: http://www.TrilliumSoftware.de

Pressekontakt:

Holger Hagenlocher, Agentur für Marketing & PR

Otto-Lilienthal-Straße 36, D-71034 Böblingen

Tel: +49 (0)7031 / 71 49 35

Fax: +49 (0)7031 / 71 49 39

E-Mail:

Website: http://www.hagenlocher-pr.com

Über das Unternehmen

TRILLIUM SOFTWARE

Die Harte-Hanks Trillium Software Germany GmbH ist die Deutschland-Tochter von Trillium Software. Das Unternehmen bietet Software-Lösungen, die Daten in CRM- (Customer Realtionship Management), E-Business- und Internet-Anwendungen erkennt, standardisiert und erweitert. Die Lösungen erstrecken sich auch auf DWH (Data Warehousing), BI (Business Intelligence), ERP, SCM (Supply Chain Management) sowie weitere Anwendungskategorien.

Das Trillium Software System kann weltweit über 1.600 Implementierungen vorweisen und wird in hunderten von geschäftskritischen Applikationen eingesetzt. Hier ermöglicht es die Technologie von Trillium Software global agierenden Unternehmen, in Echtzeit eine einheitliche Sicht auf ihre Kunden, Partner und Distributoren.

TRILLIUM SOFTWARE ist im Harte-Hanks Unternehmensverbund mit mehr als einer Milliarde Dollar Umsatz der Lösungspartner für alle Fragen des Datenqualitätsmanagements. Das Betätigungsfeld erstreckt sich von der Analyse bis zum Data Cleansing - vom Stammdatenmanagement bis zu Kunden- und Lieferantenadressen.

Weitere Informationen unter http://www.trilliumsoftware.de

Die Harte-Hanks Trillium Software Germany GmbH ist die Deutschland-Tochter von Trillium Software. Das Unternehmen bietet Software-Lösungen, die Daten in CRM- (Customer Realtionship Management), E-Business- und Internet-Anwendungen erkennt, standardisiert und erweitert. Die Lösungen erstrecken sich auch auf DWH (Data Warehousing), BI (Business Intelligence), ERP, SCM (Supply Chain Management) sowie weitere Anwendungskategorien.

Das Trillium Software System kann weltweit über 1.600 Implementierungen vorweisen und wird in hunderten von geschäftskritischen Applikationen eingesetzt. Hier ermöglicht es die Technologie von Trillium Software global agierenden Unternehmen, in Echtzeit eine einheitliche Sicht auf ihre Kunden, Partner und Distributoren.

TRILLIUM SOFTWARE ist im Harte-Hanks Unternehmensverbund mit mehr als einer Milliarde Dollar Umsatz der Lösungspartner für alle Fragen des Datenqualitätsmanagements. Das Betätigungsfeld erstreckt sich von der Analyse bis zum Data Cleansing - vom Stammdatenmanagement bis zu Kunden- und Lieferantenadressen.

Weitere Informationen unter http://www.trilliumsoftware.de

Pressebericht „Data Profiling analysiert die Qualität des Datenbestands - Webinar zum Thema Datenqualität am 3. April 2008“ bearbeiten oder mit dem "Super-PR-Sparpaket" stark hervorheben, zielgerichtet an Journalisten & Top50 Online-Portale verbreiten:

Disclaimer: Für den obigen Pressetext inkl. etwaiger Bilder/ Videos ist ausschließlich der im Text angegebene Kontakt verantwortlich. Der Webseitenanbieter distanziert sich ausdrücklich von den Inhalten Dritter und macht sich diese nicht zu eigen. Wenn Sie die obigen Informationen redaktionell nutzen möchten, so wenden Sie sich bitte an den obigen Pressekontakt. Bei einer Veröffentlichung bitten wir um ein Belegexemplar oder Quellenennung der URL.

Weitere Mitteilungen von TRILLIUM SOFTWARE

Master Data Management – Der lange Weg zum Unternehmensstandard

Web Seminar („Webinar“) am 12. Juni 2008, 14:00 Uhr

Teilnahme kostenlos - Anmeldung erforderlich

Ort: trilliumsoftware. webex.com unter Event Center

(hh) Das Master Data Management bezeichnet die zentrale Verwaltung von Stamm- oder Referenzdaten (master data), um eine system- und anwendungsübergreifende Konsistenz sicherzustellen. Stammdaten werden häufig in unterschiedlichen Datenverwaltungssystemen redundant gehalten. Dies führt in der Regel dazu, dass der notwendige Datenabgleich zeit- und kostenaufwändig ist.

Bei der Stammdaten-Konsolid…

Berlin für drei Tage der Nabel der SAP-Welt - TRILLIUM SOFTWARE bei der SAPPHIRE 2008

Berlin für drei Tage der Nabel der SAP-Welt

TRILLIUM SOFTWARE bei der SAPPHIRE 2008

(Links zu Bild-/Fotomaterial finden Sie am Ende des Textes!)

Bereits an den Veranstaltungsorten, an denen die SAPPHIRE Station macht, ist der Stellenwert des alljährlich stattfindenden internationalen SAP-Anwenderforums deutlich abzulesen: Ausschließlich Hauptstädte dürfen die Veranstaltung ausrichten. Nach Paris im vergangenen Jahr ist nun die deutsche Hauptstadt an der Reihe: Vom 19. bis zum 21. Mai findet die SAPPHIRE 2008 in Berlin statt. Mit eigenem Stan…

Das könnte Sie auch interessieren:

Schnelltest für SAP-Datenqualität

… Bewegungsdaten auf die Geschäftsprozesse transparent und trägt damit zu signifikanten Einsparungen im Bereich der Prozesskosten bei.

Obwohl die meisten Unternehmen die Datenqualität als hochkritisches Anliegen bewerten, gibt es in der Geschäftswelt noch gewaltigen Nachholbedarf an systematischem Stammdatenmanagement. Der DQ Quick Scan bietet Unternehmen, …

SAP®- und Data-Quality-Kompetenz aus einer Hand

Passgenaue Gesamtlösungen rund um Datenqualität im SAP®-Umfeld: Uniserv SAP® DQ Competence Center vereinigt Know-how von Uniserv und paricon

- Kostengünstiger Einstieg durch kompakte Starterpakete und attraktive SaaS-Angebote

Pforzheim, Juli 2009. Mehr und mehr setzt sich in Unternehmen die Erkenntnis durch, dass ein effizientes Management der Unternehmensprozesse …

Information Builders: Sechs Schritte steigern die Datenqualität

Eschborn, 18. Juli 2017 – Schlechte Datenqualität kostet Zeit und Geld, schlimmstenfalls führt sie sogar zu erheblichen Umsatzverlusten. In sechs Tipps zeigt Information Builders, wie Unternehmen die Konsistenz und Zuverlässigkeit ihrer Daten verbessern können.

Eine mangelhafte Qualität von Daten, speziell von Kundendaten, führt schnell zu gravierenden …

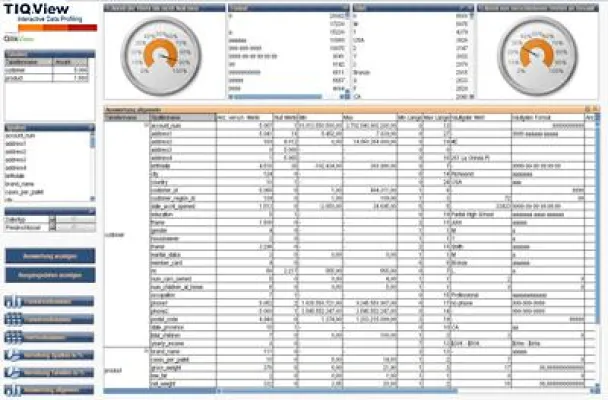

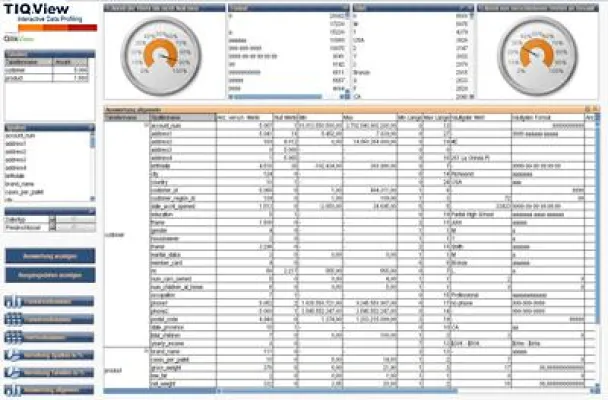

TIQ Solutions GmbH bringt erstes Fachanwender-Werkzeug für systematische Datenqualitätsanalysen in Unternehmen

Leipzig / Sachsen – Mit TIQView hat die Leipziger TIQ Solutions GmbH eine spezielle Datenqualitätsapplikation entwickelt, mit der interaktives Data Profiling selbst für Fachanwender kein Problem mehr ist. Endlich ist es möglich, ohne aufwendigen Support durch die IT-Abteilungen direkt in den Fachbereichen unterschiedliche Datenquellen auf Qualitätsprobleme …

Neue Uniserv Data Quality Solutions decken Prozesse für Datenqualität lückenlos ab

Führende Analysten weisen Datenqualität zentrale Bedeutung für Unternehmenserfolg zu – Data Quality Cycle sichert Datenqualität als Basis optimierter Geschäftsentscheidungen – Customer- und Non-Customer-Data im Fokus

Pforzheim, Juli 2008. Der Erfolg jedes Unternehmens steht und fällt insbesondere mit der Qualität der vorgehaltenen Daten. Das bestätigen …

Datenqualität hat einen neuen Standort

Stuttgart. Die Firma TOLERANT Software - spezialisiert auf Datenqualität- bezog zum 1.8.2009 ihre neuen Räumlichkeiten im Stuttgarter Bosch-Areal. Geschäftskunden erhalten von dort aus Beratung und maßgeschneiderten, unbürokratischen Support zum Thema Datenqualität. In Zeiten, in denen die Datenberge immer höher werden, sind Unternehmen gezwungen ein …

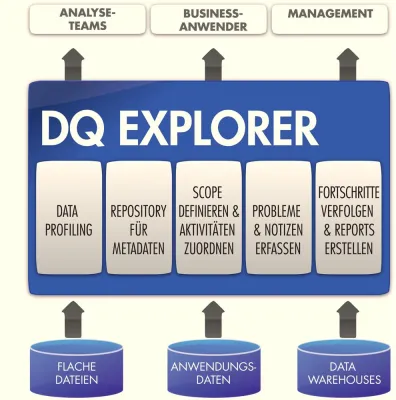

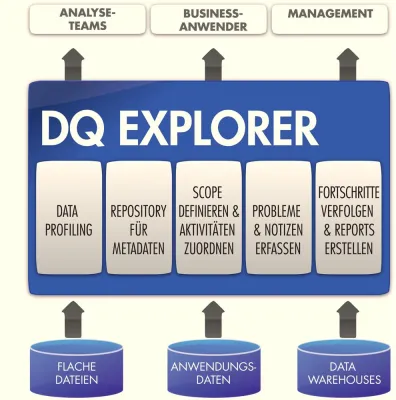

DQ Explorer von Uniserv optimiert Datenqualität via Analysis & Profiling

… Daten von niedriger Qualität sind allgegenwärtig. Falsche Artikelnummern, fehlende Werte, unterschiedliche Schreibweisen und Abkürzungen, fehlerhafte Kundendaten etc. mindern die Datenqualität und führen zu negativen wirtschaftlichen Folgen. Das Garbage-in-Garbage-out-Prinzip greift: Fehler in den Daten führen zu falschen Entscheidungen, hohen Kosten …

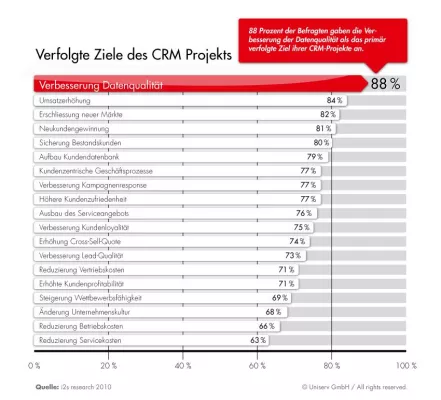

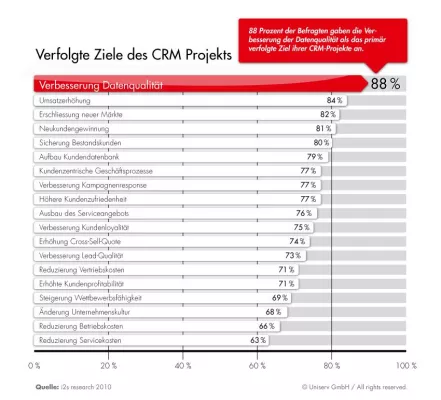

Datenqualität ist bei CRM-Projekten Pain N°1

i2s-Studie belegt Investitionswillen von CRM-Anwendern – Datenqualität ist Sorgenkind bei Implementierung und Betrieb – Uniserv-Lösungen gewährleisten optimale Ergebnisse bei Datenmigration und -qualität

Pforzheim, 8. Dezember 2010. 51 Prozent aller Customer Relationship Management (CRM)-Anwender wollen 2011 Investitionen in ihre Software tätigen. Ziel …

Kostenloses Webinar zu Profiling und individualisiertem Dialogmarketing am Beispiel der UNO Flüchtlingshilfe

Wie lässt sich individualisiertes Online Dialogmarketing zielgenau an den Interessen des einzelnen Nutzers ausrichten? Wie lassen sich Zustimmungen zum personenbezogenen Profiling rechtssicher einholen? Diese Fragen beantwortet die artegic AG am Beispiel der UNO Flüchtlingshilfe in einem kostenfreien Webinar am 05. Juni um 14:00 Uhr. Die vorgestellte …

Information Builders: Fünf Schritte für vertrauenswürdige IoT-Daten

Eschborn, 16. Oktober 2018 - Unternehmen, die IoT-Lösungen einsetzen, benötigen eine Datenqualitätsstrategie. Was bei BI und der Analyse sowie Aufbereitung betriebswirtschaftlicher Daten vielfach verbreitet ist, sollten Unternehmen auch bei IoT-Daten etablieren. Information Builders erläutert die wichtigsten Maßnahmen für Aufbau und Betrieb eines Programms …

Sie lesen gerade: Data Profiling analysiert die Qualität des Datenbestands - Webinar zum Thema Datenqualität am 3. April 2008